计算机视觉技术 驱动自动驾驶发展的核心引擎

在当今科技飞速发展的时代,自动驾驶技术正逐步从科幻走向现实,而其中,计算机视觉技术扮演着至关重要的角色。作为感知和理解外部世界的“眼睛”,计算机视觉技术为自动驾驶系统提供了不可或缺的环境感知能力,使其能够安全、可靠地在复杂多变的道路环境中行驶。

计算机视觉技术在自动驾驶领域的应用广泛而深入。目标检测与识别 是其基础功能。通过摄像头捕捉图像,系统能够实时识别出行人、车辆、交通标志、车道线、信号灯以及其他关键道路元素。例如,利用深度学习模型如YOLO(You Only Look Once)或SSD(Single Shot MultiBox Detector),系统可以在毫秒级别内完成对图像中多个目标的精准定位和分类,为后续的决策规划提供信息基础。

语义分割 技术能够对图像中的每一个像素进行分类,从而更精细地理解场景。这有助于车辆区分可行驶区域、人行道、路肩、绿化带等,尤其是在非结构化或复杂环境中(如施工区域、停车场)至关重要。它帮助车辆构建一个像素级的语义地图,提升环境理解的深度。

深度估计与三维重建 是另一个关键方向。通过单目、双目或多目摄像头,计算机视觉技术可以估算物体与车辆之间的距离,重建出三维场景结构。立体视觉通过模拟人眼视差来获取深度信息,而基于单目图像的深度估计则利用深度学习模型从单一图像中推断深度,尽管精度可能略逊于立体视觉,但成本更低。这对于判断潜在碰撞风险、规划安全路径至关重要。

视觉里程计(Visual Odometry)与同步定位与地图构建(SLAM) 技术则使车辆能够在GPS信号弱或无信号的区域(如隧道、城市峡谷)实现自我定位和地图构建。通过分析连续图像帧之间的特征点变化,系统可以估算车辆自身的运动轨迹,并结合其他传感器(如IMU)构建或更新环境地图,实现高精度的定位。

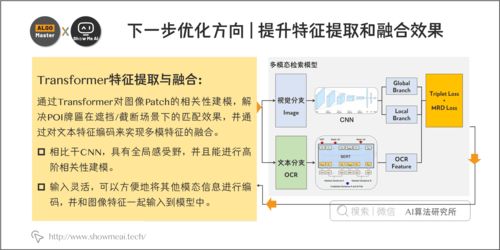

多传感器融合 虽然计算机视觉是核心,但自动驾驶系统通常不会仅依赖视觉。计算机技术开发 在此扮演了整合者的角色。通过将摄像头数据与激光雷达(LiDAR)、毫米波雷达、超声波传感器以及高精度地图和GNSS数据进行融合,系统能够获得更鲁棒、更全面的环境感知。融合算法(如卡尔曼滤波、粒子滤波以及基于深度学习的融合网络)能够弥补单一传感器的局限性(如视觉在恶劣天气或光照条件下的性能下降),提升整体系统的安全性和可靠性。

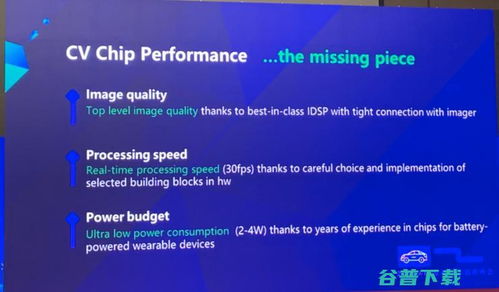

安霸(Ambarella)公司及其创始人之一阿尔贝托·布罗吉(Alberto Broggi)教授在推动计算机视觉于自动驾驶的应用方面贡献卓著。布罗吉教授是自动驾驶领域的先驱,早在20世纪90年代就领导了著名的ARGO项目,展示了基于视觉的自动驾驶汽车长途旅行。安霸公司则专注于低功耗、高性能的视觉处理芯片设计,其SoC(系统级芯片)能够高效运行复杂的计算机视觉算法,为自动驾驶摄像头提供强大的边缘计算能力,是实现实时、高效视觉处理的关键硬件支撑。

计算机视觉技术在自动驾驶领域仍面临诸多挑战,如应对极端天气、复杂光照、遮挡以及长尾场景(罕见但危险的情况)的鲁棒性。随着深度学习算法的不断演进、算力的持续提升以及传感器融合技术的日益成熟,计算机视觉必将继续作为自动驾驶技术发展的核心驱动力,与强大的计算机技术开发能力相结合,共同推动无人驾驶时代安全、平稳地到来。

如若转载,请注明出处:http://www.zhxnext.com/product/72.html

更新时间:2026-05-25 22:42:26